Künstliche Intelligenz hat eine neue Ära der Content Creation eingeläutet! Die KI generiert in Sekundenbruchteilen maßgeschneiderte Textinhalte für Deine Zielgruppe – mit 100 % Erfolgsgarantie! So oder so ähnlich lauten die Verheißungen von ChatGPT, Google Gemini und Co. Doch ist jetzt wirklich die Zeit angebrochen, in der wir bei der Content Creation dank KI entspannt das Denken einstellen und den Geist aus der Flasche lassen können? Sind moderne Sprachmodelle tatsächlich schon in der Lage, ohne menschliches Zutun perfekte Inhalte zu generieren? Oder übersehen wir in der aktuellen Diskussion das Potenzial, das KI als Werkzeug abseits der automatisierten Textgenerierung bietet?

Texterstellung auf Knopfdruck

Es ist sicherlich ChatGPT zuzurechnen, dass heute kein Tag mehr ohne News aus dem Bereich künstliche Intelligenz vergeht. Denn die Content-Generierung mit KI ist auch deshalb aktuell so omnipräsent, weil Tools wie ChatGPT oder Midjourney das Erstellen von Text und Bild demokratisiert haben.

Praktisch jeder Mensch kann heute (oft kostenlos) leistungsfähige Tools zur sekundenschnellen automatisierten Text- und Bildgenerierung nutzen. Für viele Normalsterbliche wurde damit endlich der Traum von Autorenschaft wahr. Und auch die tiefsten Wünsche von Unternehmen und Marketing Agenturen wurden mit den Text- und Bildgeneratoren (scheinbar) erfüllt. Immerhin verspricht die neue Technologie:

- Schnellere Content-Creation-Prozesse

- Kosteneinsparungen im Personalbereich

- Präzise auf die Zielgruppe optimierte Inhalte

Und hinter alledem steht die absolute Gewissheit, dass die Maschine keine Fehler macht. Punkt!

Doch das Potenzial künstlicher Intelligenzen allein in ihrer Nutzung als vollautomatische Bild- und Textgeneratoren zu suchen, ist in die falsche Richtung – und damit zu kurz – gedacht.

Als Textagentur haben wir uns seit einiger Zeit eingehend mit verschiedenen frei zugänglichen Sprachmodellen beschäftigt und die Ergebnisse unserer Testreihen in einem bald öffentlich zugänglichen Whitepaper (inklusive Praxisbeispiele) zusammengefasst. Das Bild, das sich uns dabei präsentierte, war eher ernüchternd: Der Geist in der Maschine ist in vielerlei Hinsicht weniger geistreich als gedacht. Doch trotz der oft eher durchschnittlichen Qualität der generierten Texte zeigte sich eines deutlich: Generative KI hat das Potenzial, als Werkzeug und Hilfestellung den Prozess der Content-Produktion effizienter zu gestalten – ohne dabei auf die Kreativität eines menschlichen Verstandes verzichten zu müssen.

Gute Zeilen, schlechte Zeilen: Textqualität ist subjektiv, Technik ist es nicht

Wenn Du jetzt bereits zusammengezuckt bist, weil Du erkannt hast, dass diese durchaus kritische Auseinandersetzung mit der vollautomatisierten KI-Content-Creation von jemandem verfasst wurde, der sein Geld mit dem Schreiben hochwertiger Online-Textinhalte verdient, dann zunächst: Herzlichen Glückwunsch! Du bist offensichtlich in der Lage, Informationen kritisch zu hinterfragen und zu bewerten. Das wird im Rahmen Deiner Arbeit mit KI noch wichtig werden!

Doch es ist verständlich, dass hier gewisse Vorbehalte bestehen. Darum möchten wir in diesem Rahmen auch gar nicht das Fass aufmachen, die Qualität der von Textgeneratoren erstellten Inhalte „objektiv“ zu beurteilen. Denn obwohl uns vielerlei Anbieter – gerade aus dem Bereich KI-Tools – suggerieren, dass eine rein mechanistische Betrachtung nach dem Schema „Formulierung A erzeugt immer Emotion X“ möglich sei, ist diese Sicht auf Sprache doch zumindest diskussionswürdig. Der menschliche Verstand ist vielschichtig und sein Sprachverständnis wird von individuellen Kombinationen aus Parametern wie Bildungshintergrund, sozialem Umfeld oder sogar Alterskohorte geprägt.

Stattdessen möchten wir uns im Folgenden vor allem mit denjenigen rein technischen Aspekten auseinandersetzen, die die Kreation von Texten durch künstliche Intelligenz aktuell noch beschränken. Im Anschluss zeigen wir auf, wie Du KI dennoch sinnvoll in den Prozess der Texterstellung integrieren kannst, bevor wir zum Fazit schreiten. Wir konzentrieren uns hier vor allem auf unsere Erfahrungen mit öffentlich zugänglichen Large Language Models und deren Benutzeroberflächen. Die Möglichkeit, individuelle KIs mit proprietären Daten auf die Content-Erzeugung für spezifische Unternehmen zu trainieren, lassen wir außen vor. Doch wenn Du Dir die folgenden technischen Einschränkungen anschaust, die allen aktuellen generativen KIs gemein sind, wirst du vielleicht auch zu der Vermutung gelangen: Allein durch den Aufbau eines eigenen Informations-Reservoirs werden sich nicht alle dieser fundamentalen technischen Hürden aus dem Weg räumen lassen.

Wie funktioniert KI überhaupt? Und warum hindert sie das (noch) daran, wirklich gute Texte zu schreiben?

Alle aktuell öffentlich zugänglichen generativen KIs basieren auf derselben technischen Grundlage: Ein Large Language Model wird mit Millionen und Milliarden von Daten trainiert, um ein Verständnis über die Funktionsweise einer Sprache zu erhalten – ihre Grammatik, ihr Vokabular und sogar die aktuelle Sprachpraxis. Dieses Wissen erlaubt es einem neuronalen Netzwerk, Sprache zu interpretieren und ihrerseits natürlich klingende Sprache zu produzieren. Das schaffen die meisten KIs bereits sehr gut. Allein die Tatsache, dass die von Sprachmodellen generierten Texte grammatisch funktional sind und Sinn ergeben, ist eine bedeutende technische Errungenschaft. Doch mit dieser Herangehensweise gehen einige Einschränkungen einher.

1. Generative KI kann nur die Karten neu mischen

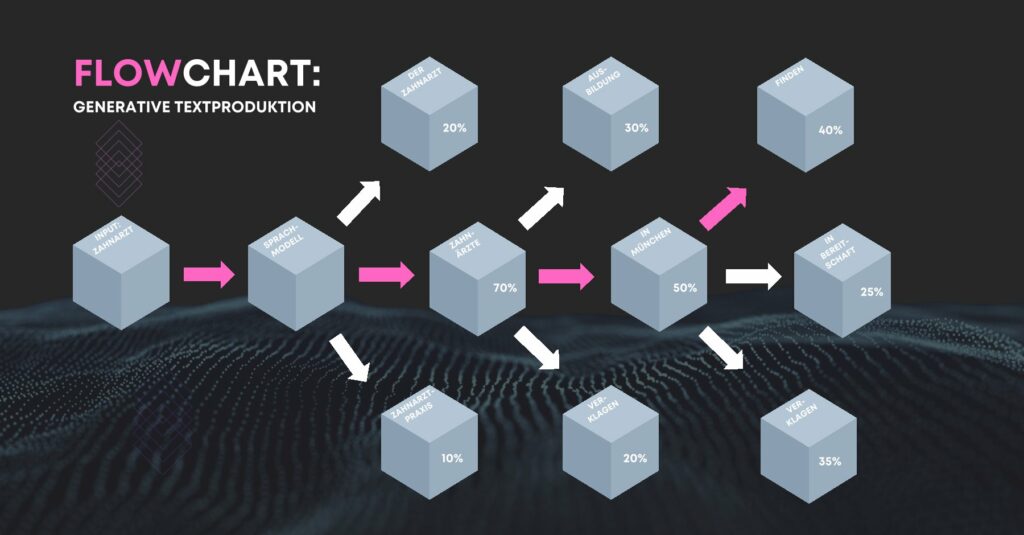

Die sogenannte generative künstliche Intelligenz ist (noch) nicht in der Lage, wirklich kreativ zu schreiben. Das liegt daran, wie sie ihre Inhalte generiert: Gibst Du dem System einen Prompt vor – als Praxisbeispiel: „Schreibe einen Webseitentext zum Thema X“ – dann wird es den Satz analysieren und seine Aussage nachvollziehen: Eine Aufforderung zur Erzeugung eines Responses zu „X“. Was als nächstes geschieht, ist dann rein automatisiert: Die KI erzeugt immer neue Worte, beginnend mit „X“. Welches Wort auf X folgt, wird daran festgemacht, welches Wort in den Trainingsdaten des Large Language Models mit höchster Wahrscheinlichkeit auf „X“ folgte.

Generative Textproduktion

Selbstverständlich lassen die Systeme hier auch Kontext mit hineinspielen („Stell Dir vor, Du bist ein Journalist. Schreibe nun einen Text zum Thema X“). Und sie sind in der Lage, dieses starre Vorgehen auf Wunsch aufzulockern und manchmal auch Begriffe auszuwählen, die nicht mit höchster Wahrscheinlichkeit auf den vorherigen Begriff folgen. Dazu nutzt Du den Temperature-Wert. Ihn kannst Du in einigen Benutzeroberflächen per Regler einstellen und bei Tools wie ChatGPT per Prompt vorgeben („Nutze dazu Temperature 0,8“).

Eine originelle Idee oder ein kreativer Ansatz kann jedoch aufgrund des grundsätzlichen Vorgehens der künstlichen Intelligenz in jedem Fall nur ein Zufallstreffer sein. Denn die Textgeneratoren (und Bildgeneratoren) versuchen lediglich, flexibel das nachzubilden, was sie bereits in ihren Datenbanken gespeichert haben. Textgeneratoren wie ChatGPT produzieren dabei zwar natürliche Sprache und sprachlich akzeptable Texte, aber sie werden in der Regel nicht über dieses Level hinausgehen. In unseren Testreihen waren wir zu keinem Zeitpunkt überrascht oder gar begeistert von vollautomatisch erzeugten Inhalten.

Schon hier lässt sich erkennen: Das, was wir aktuell als künstliche Intelligenz bezeichnen, ist noch weit davon entfernt, tatsächlich selbstständig zu denken. Die Systeme sind gewissermaßen nur besonders komplex aufgebaute Programme zur Kreation natürlich klingender Sprache – vergleichbar mit Autocomplete-Algorithmen, nur deutlich flexibler und leistungsfähiger. Dass die von ihren Sprachmodellen generierte Sprache so natürlich klingt, verführt im Umkehrschluss dazu, die Systeme zu vermenschlichen und ihnen Fähigkeiten zuzuschreiben, die sie einfach (noch) nicht besitzen: eigenständiges Denken und Kreativität. Ähnlich verhält es sich bei der Bildgenerierung, bei der bekanntlich lediglich das kreative Schaffen menschlicher Künstler:innen als Trainingsdaten analysiert und nachempfunden wird.

2. Generative KI denkt in Tokens

Um vom User oder der Userin getätigte Eingaben (Prompts) verstehen und eigene Ausgaben (Responses) zu erzeugen, zerlegen KIs Begriffe in ihre bedeutungstragenden Bestandteile – sogenannte Tokens. Sie geben dem Sprachmodell Aufschluss über die Gesamt-Bedeutung der Sätze, mit denen die Systeme konfrontiert werden. Das kannst Du dir vereinfacht vorstellen, als würde das System Sätze in Silben (oder für die Linguisten: Morpheme) aufteilen und deren Bedeutung einzeln interpretieren und in einen Zusammenhang setzen – auch wenn Tokens faktisch nicht gleichbedeutend mit Silben (oder Morphemen) sind.

Das Problem, das sich durch diese Herangehensweise für die effiziente Content-Erzeugung ergibt, ist, dass die aktuellen KIs aufgrund beschränkter Rechenkraft noch stark eingeschränkt darin sind, wie viele Tokens sie innerhalb eines einzelnen Vorgangs bearbeiten können:

- KIs können nicht weiter als bis zu einer maximalen Token-Anzahl „zurückdenken“.

- KIs produzieren in der Regel nur Responses, bis ihre maximale Token-Anzahl erreicht ist.

- Je länger der Input (Prompt) des Users oder der Userin, desto kürzer der Output (Response).

Generative Tools wie ChatGPT können in den meisten Fällen problemlos kleinere Texte – zum Beispiel Produktbeschreibungen – selbstständig verfassen. Doch bei größeren Vorhaben – zum Beispiel Content für längere Kategorietexte – tun sie sich aufgrund dieser Token-Beschränkung noch schwer. Hier kann es sein, dass die KI nach Erreichen der maximalen Token-Anzahl (inklusive Input-Tokens) einfach die Textproduktion einstellt, manchmal mitten in einem Satz.

Dieses Problem kannst Du auf zwei Arten umgehen. Bricht die KI die Inhaltserstellung nach der maximalen Anzahl an Tokens ab, kannst Du sie in der Regel dazu prompten, die Content Creation auf Basis des bereits vorhandenen Texts fortzusetzen. Dann stellt sich jedoch das ebenfalls auf Tokens basierende „Gedächtnis“ der KI als Hindernis heraus. Denn die Systeme können sich in der Regel nicht an unbegrenzt viel Textinput „erinnern“. Stell Dir vor, Du schreibst einen Text, aber Dein Gedächtnis löscht alles Wissen aus, das mehr als 30 Minuten alt ist. Hier sind Redundanzen und Kohäsionsprobleme fast schon vorprogrammiert.

Die zweite Möglichkeit ist es, die KI dazu zu prompten, zunächst eine Struktur für Inhalte zum jeweiligen Thema zu erstellen. Dann kannst Du ihr im Nachgang in Einzelschritten die Aufgabe stellen, zu jedem der Strukturpunkte Einzeltexte zu generieren, die Du anschließend zusammensetzt. Das Problem dabei ist, dass die KI dann natürlich die einzelnen Texte alleinstehend erzeugt – und sich höchstens bis an die maximale Token-Grenze daran „erinnert“, was sie zuvor geschrieben hat. Das kann zu Problemen mit der Textkonsistenz und -kohärenz führen, wenn zum Beispiel in jedem Abschnitt unterschiedliche Begriffe verwendet oder grundsätzliche Informationen in jedem Abschnitt erneut vermittelt werden.

3. Künstliche Intelligenz hat ein Informationsproblem

Wie bereits dargestellt, generiert KI Inhalte auf Basis ihrer Trainingsdaten. Das bedeutet auch, dass das System nicht mitdenkt, welche Informationen es mit dem jeweiligen Text vermittelt. Es steckt lediglich Worte und Phrasen aneinander, die aneinander passen – als würdest Du mit Lego-Steinen einfach drauflosbauen, ohne darauf zu achten, was das Gesamtkonstrukt am Ende darstellen soll. Das kann zu einem Phänomen führen, das als „Halluzinationen“ bekannt ist: Die KI gibt Falschinformationen aus, formuliert diese jedoch so, als sei sie sich ihrer Sache absolut sicher. Als User:in ist man dann dazu geneigt, die vermeintliche Expertenrolle des Systems einfach unbesehen zu akzeptieren und falsche Informationen zu übernehmen.

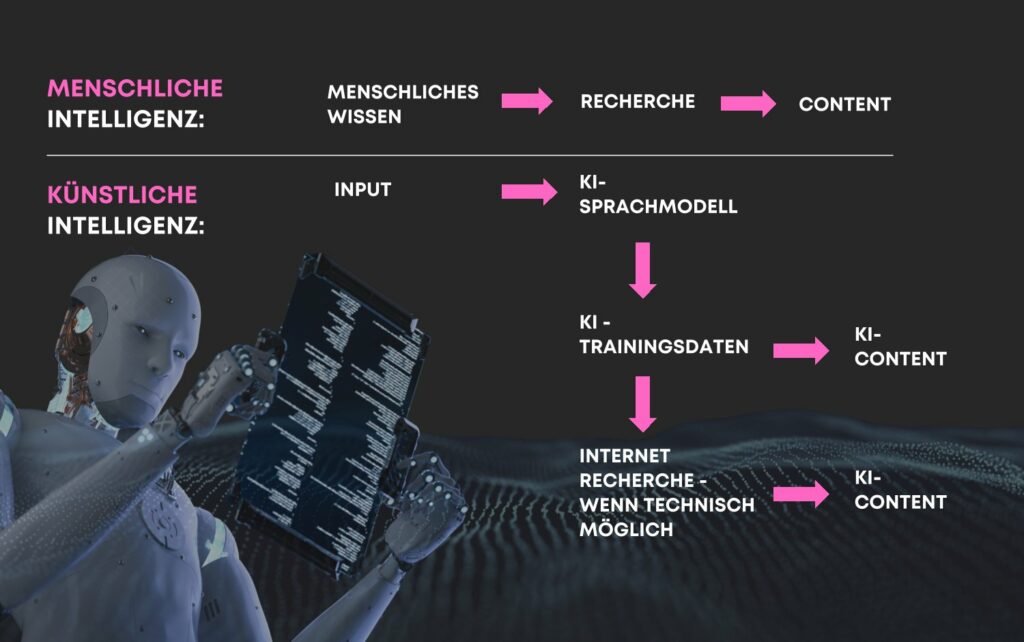

Hier spielt die Frage eine Rolle, ob die KI ausschließlich auf ihre Trainingsdaten zugreifen oder wie zum Beispiel bei Google Gemini auch aktiv das Internet durchforsten kann. Ungeachtet der Aktualität der Informationen kann es jedoch vorkommen, dass KIs Informationen generieren, die für jeden Menschen mit einem Mindestmaß an Weltwissen als falsch identifizierbar wären. So ließ uns eine der von uns getesteten KIs auf die Frage, wer aktuell Bundeskanzler sei, wissen: „Seit März 2018 ist Merkel nach Winfried Kretschmann (bis 2021) und Frank-Walter Steinmeier (2017) die dritte weibliche Kanzlerin.“

Menschliche vs künstliche Intelligenz

Darum gilt in jedem Fall: Wer KI in der Content Creation einsetzt, sollte zumindest alle getätigten Aussagen überprüfen. Einfach davon auszugehen, „die Maschine wird es schon wissen“ ist ein deutliches Risiko, das eventuell sogar juristische Folgen nach sich ziehen könnte.

4. Content Creation mit SEO-Vorgaben – geht das?

Prinzipiell lassen sich KIs auch dazu bringen, Inhalte nach sehr spezifischen Vorgaben zu erstellen. Ein typisches Beispiel ist das Verwenden eines bestimmten Schreibstils. Bei der Content Creation für Online-Medien und Webseiten ist vor allem die Suchmaschinenoptimierung relevant. Das Problem an dieser Stelle ist, dass die KI Dir zwar versichern wird, dass sie einen suchmaschinenoptimierten Text erstellen kann. Bei einer nachträglichen Prüfung stellt sich jedoch meist heraus, dass der erzeugte Text nicht durchgehend optimiert wurde – zumindest nicht über das Maß, das sich natürlicherweise aus dem vorgegebenen Thema (Keyword) ergibt. Vorgegebene Keywords können die meisten KIs in der Regel im Textkörper platzieren, wenn sie dazu aufgefordert werden. Doch das tun sie in vielen Fällen unbedacht. Wiederholungen und Keyword-Stuffing sind dann an der Tagesordnung, wodurch eine längere Nachbearbeitungszeit die Schreibprozesse aufbläht.

Der Grund für diese Schwäche ist wiederum technisch bedingt: Da die künstliche Intelligenz fortlaufende Sätze auf Basis von Wahrscheinlichkeiten erstellt (vereinfacht: auf Wort X folgt mit 70 % Wahrscheinlichkeit Wort Y), können generative KIs genauso wenig spezifische Begriffe natürlich in einem Text verteilen, wie sie rechnen können – es ist einfach technisch nicht vorgesehen. Selbst eine vorgegebene Wortanzahl können die Systeme in unserer Erfahrung nicht verlässlich einhalten, da sie Texte ja ohnehin als Tokens wahrnehmen, und nicht als Worte. Allerdings stören sich die KIs daran meist wenig und behaupten hinterher mit absoluter Sicherheit, dass die erzeugten Inhalte entsprechend optimiert seien. Auch hier gilt: Nachprüfen ist sicherer als Vertrauen.

Zwischenfazit: Die aktuelle Generation künstlicher Intelligenz ist technisch noch beschränkt

Ungeachtet rein subjektiver Definitionen, was einen „guten Text“ ausmacht, muss festgehalten werden, dass aktuelle generative KIs gerade bei Arbeiten wie dem kreativen Schreiben noch mit technischen Einschränkungen zu kämpfen haben. Dadurch sind die Tools zwar gut als Chatbot oder als Generatoren für Kurztexte geeignet. Doch je komplexer und länger der zu erstellende Inhalt werden soll, desto mehr Hürden stellen sich der Wundermaschine bei der Content-Generierung. Und desto mehr Nachbearbeitungsaufwand ist in der Regel notwendig. Zum Beispiel zur nachträglichen Suchmaschinenoptimierung, zur Verifizierung von Informationen etc.

Und auch ein ausgeklügelt formulierter Prompt ist kein Zauberspruch, den man nur aufzusagen braucht, um den perfekten Text generieren zu lassen. Wer sich dieser Tatsache nicht bewusst ist, läuft Gefahr, unbesehen Textinhalte zu nutzen, die sprachlich uninteressant oder sogar inhaltlich falsch sind.

Exkurs: Wird KI von sich selbst abschreiben?

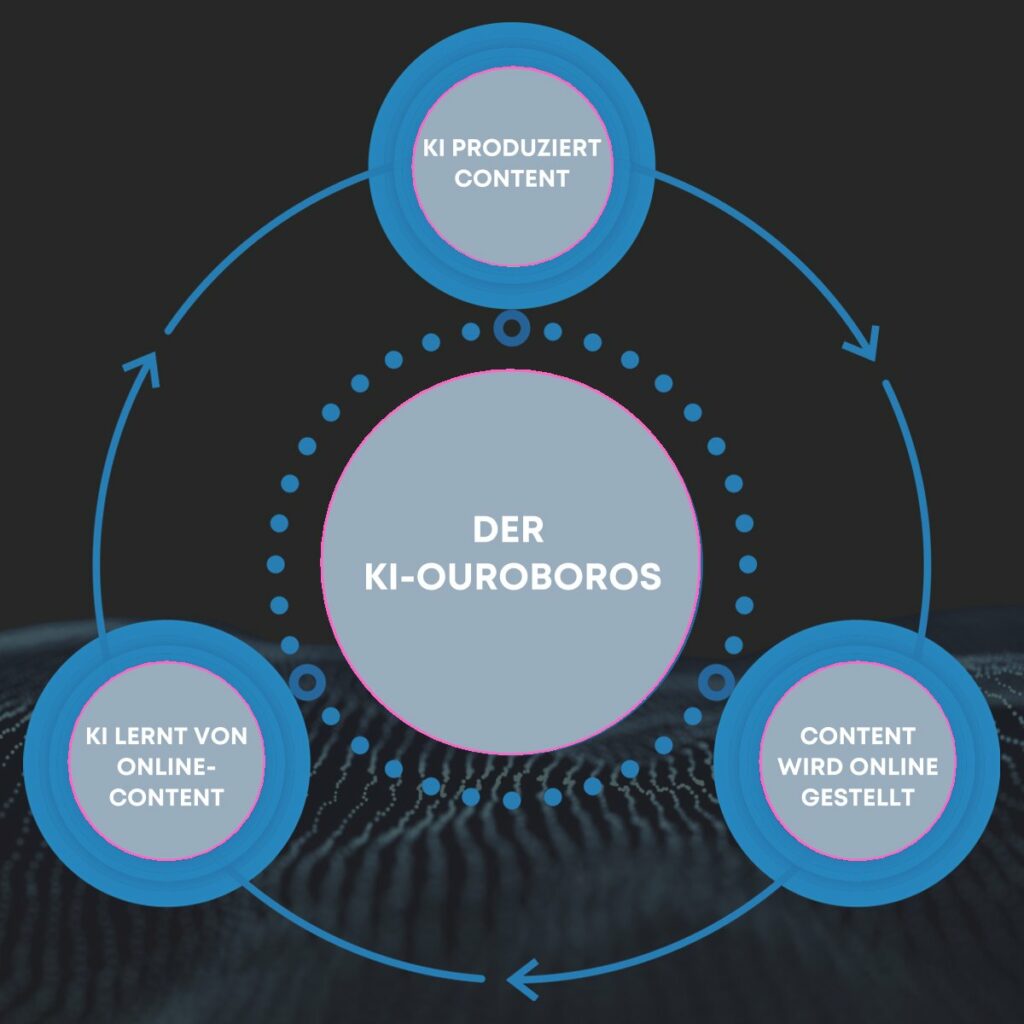

In der Frühzeit des Online-Marketings war es oft noch völlig ausreichend, mit Textinhalten zu arbeiten, die zwar weder sonderlich informativ noch schön geschrieben waren – wichtig war nur, dass sie bis zur Unlesbarkeit mit Keywords zugepflastert wurden. Diese Content- Steinzeit ist zum Glück längst vorbei und Inhalte im Internet sind unserer Einschätzung nach heute so gut wie nie zuvor. Der Status quo wird jedoch in naher Zukunft von KI-Texten maßgeblich beeinflusst werden. Denn generative KIs werden vor allem mit Inhalten trainiert, die automatisch aus dem Internet gecrawlt wurden (mit digitalisierten Büchern typischerweise an zweiter Stelle). Das heißt: Die KI lernt ihr Sprachverständnis vor allem aus dem Internet (so erschreckend dieses Konzept auch manchmal sein mag).

In der Forschung hat sich dementsprechend eine interessante Fragestellung für die Zukunft des Internets herausgebildet: Was passiert wohl, wenn das Netz mit automatisch generierten Texten aus Tools wie ChatGPT geflutet wird? Und was, wenn diese Inhalte eben nicht von Menschen redigiert und die darin enthaltenen Informationen verifiziert wurden, sondern im guten Glauben an die Überlegenheit der künstlichen Intelligenz einfach online gestellt wurden? Dann könnten Sprachmodelle ihr Sprachverständnis und ihr Weltwissen in Zukunft aus Texten beziehen, die wiederum inhaltlich falsch und stilistisch wenig ansprechend sind. Texte, die eventuell ernsthafte Kohärenzprobleme haben, da sie aufgrund eines Token-Limits Stück für Stück zusammengesetzt wurden. Oder einfach Textinhalte, die typische KI-Schwächen aufweisen – häufige Wiederholungen, Füllsätze etc. Das alles ist aktuell noch reine Spekulation. Es liegt an Deinem Umgang mit der Technik, ob dieser Fall in Zukunft eintreten könnte.

Der KI-Ouroboros

Lass die KI tun, was sie am besten kann!

Künstliche Intelligenz ist für die Content Creation das, was eine Kettensäge im Gartenbau ist – ein Werkzeug (darum auch „Tool“). Und genau wie eine Kettensäge solltest Du die KI nicht einfach „machen lassen“, ohne dabei eine führende Hand anzulegen. Aus diesem Grund empfehlen wir, die Systeme (wenn überhaupt) nur unter strengster Beobachtung frei schreiben zu lassen. Gerne auch einfach zur Inspiration und Lösung von Kreativitätsblockaden, aber nie ohne Zutun des Menschen.

Statt sich also an der Idee festzuklammern, mit dem „perfekten Prompt“ auf Knopfdruck veröffentlichungsfertige Texte zu produzieren, sollten wir viel stärker darauf eingehen, an welchen Stellen die KI den Content-Creation-Prozess unterstützen kann – ohne den Anspruch, die Kreativität des Menschen vollständig daraus zu eliminieren.

Angriffspunkt 1: Informationsrecherche im Rahmen der Content Creation

In unseren Tests haben sich unterschiedliche generative Tools sehr effektiv bei der Aufbereitung von Informationen entpuppt. Auch hier gilt wieder die Einschränkung, dass Du alle von den Systemen zur Verfügung gestellten Informationen verifizieren musst – Stichwort „Halluzinationen“.

Die ersten Chatbots haben jedoch bereits Funktionen, die es ihnen erlauben, ihre Quellen offenzulegen. Die Verifikation von Fakten und Zahlen ist also längst nicht mehr so schwer, wie sie einmal war. Zitiert die KI zum Beispiel eine Studie mit Titel und Autor:in oder ein Gerichtsurteil mit Aktenzeichen, dann lässt sich in der Regel schnell verifizieren, ob diese Quellen frei erfunden sind oder nicht.

Und obwohl die KI lediglich Worte aus dem Fundus ihrer Sprachmodelle nach Wahrscheinlichkeiten zusammensetzt, können Dich ihre Aussagen durchaus bei der Recherche auf die richtige Fährte führen oder Kreativitätsblockaden beim Schreibprozess lösen. Beachte auch hier, ob die von Dir genutzte künstliche Intelligenz das Internet aktiv durchsuchen kann, oder lediglich aus ihren (möglicherweise veralteten) Trainingsdaten schöpft.

Angriffspunkt 2: Informationssammlung, -aufbereitung und -strukturierung

Eine Aufgabe, bei der Generative KI gute Hilfe leisten kann, ist das Handhaben großer Datenmengen. Eigentlich kein Wunder, denn genau diese Fähigkeit haben die Programme ja durch das Verarbeiten von Milliarden von Trainingsdaten gelernt. Einige Tools kannst Du heute schon mit Daten in Form von Textdokumenten füttern. Diese lassen sich dann über die KI aufbereiten und zusammenfassen. Oder Du bekommst die Möglichkeit, dem Chatbot spezifische Fragen zu den Inhalten der Texte zu stellen. Manche Systeme liefern dann sogar die relevanten Zitate aus den Dokumenten gleich mit – auch hier wieder: Vorsicht vor Halluzinationen!

Speziell für den Bereich Online Content Creation mit KI lassen sich mit den richtigen Prompts auch Strukturen, Themenvorschläge und Anregungen von der KI produzieren. So unterstützen Dich die Systeme im Strategieprozess genauso wie bei der Inhaltserstellung – die eigentlichen Formulierungen liegen jedoch weiterhin in der Hand eines (hoffentlich) kreativen Menschen. Damit gestaltest Du einen Großteil der Vorarbeit für die Content Creation mit KI schneller, was positive Auswirkungen auf die Effizienz des gesamten Texterstellungsprozesses hat.

Angriffspunkt 3: Hilfestellung im Arbeitsalltag

Von der Suchmaschine bis zu Microsoft Copilot – generative künstliche Intelligenz wird heute (auch abseits der Content-Generierung) bereits in vielen Bereichen zur Unterstützung der Effizienz genutzt. Und in all diesen Formen kann KI Dich tatsächlich auch rund um das Content Management unterstützen und allgemein Arbeitsprozesse effizienter gestalten. Da kann es schon um einfache Dinge wie die Organisation von Terminen im Arbeitsalltag oder Optimierungen im übergreifenden Strategieprozess gehen.

Potenziell können KIs auch zur Unterstützung von Redigierungswerkzeugen genutzt werden – wie wir es von gängigen Tools zur Rechtschreibprüfung kennen. Wohlgemerkt: Wir sprechen hier von speziell zu diesen Zwecken trainierten KIs. Denn in unseren Tests hat sich schnell herausgestellt, dass „generelle“ Chatbots wie ChatGPT noch gelegentlich Tippfehler übersehen. Das kann zum Beispiel dann der Fall sein, wenn das System einen Begriff noch nicht kennt, weil es sich zum Beispiel um eine ungewöhnliche Wortkoppelung handelt. Um Qualität zu gewährleisten, müssen die KIs hier noch etwas dazulernen – oder Du nutzt sie auch an dieser Stelle lediglich als Werkzeug, um einen menschlichen Proofreader zu unterstützen.

Fazit: KI direkt zum Schreiben einzusetzen ist zu weit gehofft und zu kurz gedacht

Unter dem Eindruck der zweifellos beeindruckenden neuen Technik der generativen künstlichen Intelligenz sehen wir, von der Privatperson bis zur Marketingabteilung, den Wald vor lauter Bäumen nicht mehr. Wir überschätzen das Denkvermögen der Systeme und schreiben ihnen eine Expertenrolle zu, die sie zumindest aktuell aufgrund ihrer technischen Funktionsweise noch nicht einnehmen können. Und wir nutzen in der Content Creation Systeme, die lediglich Wortreihen nach Wahrscheinlichkeiten bilden, für Arbeiten, die eigentlich von der Kreativität des Menschen profitieren würden.

Bis die Text- und Bildgeneratoren diejenigen Fähigkeiten besitzen, die wir ihnen heute schon zuschreiben, tun wir gut daran, sie als das einzusetzen, was sie sind: Ein Content-Creation-Werkzeug, das menschliche Autorinnen und Autoren unterstützen sollte, statt sie zu ersetzen.

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen

Ich finde der Artikel beschreibt treffend den momentanen Stand der KI-Technik. Für Recherche, Denkanstöße, Aufbau und Struktur, Titelgenerierung bieten die Tools eine gute Unterstützung. Aber wer selbst nichts von guten Texten versteht, der wird auch mit ChatGPT und Konsorten keinen 1A Content liefern…

Ein spannender Artikel, danke dafür 🙂 Ich bin Fotograf und habe mich eben in einem Artikel über das Thema authentische Fotografie vs. KI generierte Bilder geäussert. den Artikel gibts im Blog unserer Webseite 🙂